Si 2025 vous a semblé chargée mais par ailleurs peu productive, vous n’êtes pas seul.

Partout en Europe, beaucoup de radios ont passé l’année dernière à discuter de transformation numérique dans les moindres détails. Il y a eu des comités de pilotage, des présentations stratégiques et des roadmaps soigneusement préparées qui parlaient de podcasts, de plateformes et de l’approche audience-first. L’intention était sincère, l’énergie réelle, et les personnes impliquées souvent très compétentes.

Et pourtant, alors que 2026 commence, la réalité est que très peu de choses ont matériellement changé.

Les mêmes émissions dominent la grille. Les produits numériques restent marginaux. L’écoute à la demande est toujours traitée comme une extension du monde linéaire plutôt que comme une logique différente. Pas parce que les gens s’en fichent, mais parce que la plupart des organisations sont restées coincées en mode planification.

C’est pourquoi 2026 risque fort de ressembler à 2025, sauf si une chose change.

Pas la stratégie elle-même. Pas l’organigramme. Mais la question que vous posez.

La question qui tue le momentum

En début d’année, beaucoup d’équipes de direction se posent instinctivement la question : « Quelle devrait être notre stratégie numérique pour 2026 ? » Ça semble raisonnable, même nécessaire. Mais en pratique, ça mène presque toujours au même résultat : des mois de travail d’alignement, des ajustements des plans existants et, au final, très peu de choses qui atteignent vraiment une audience.

Le problème n’est pas la stratégie en soi. Le problème, c’est que cette question pousse les organisations vers l’abstraction. Elle récompense la cohérence sur le papier plutôt que l’apprentissage dans le monde réel.

Une question bien plus productive, plus simple et un peu inconfortable serait: « Quelle est la première chose qu’on va tester au premier trimestre ? »

Cette question force la précision. Vous ne pouvez pas vous cacher derrière l’ambition, l’intention ou les budgets. Vous devez décider ce qui sera construit, pour qui, et ce que vous espérez apprendre. Elle déplace la conversation de la vision à l’exécution, du consensus à la preuve.

Pourquoi la planification rassure, et pourquoi c’est dangereux

La planification donne l’impression de sécurité parce qu’elle semble maîtrisée. Elle produit des documents, des milestones et un sentiment de professionnalisme avec lequel les organisations sont très à l’aise.

J’ai vu ça clairement avec un groupe de radios régionales l’année dernière. Sur plusieurs mois, ils ont élaboré une stratégie de plateforme audio numérique bien réfléchie, avec un déploiement progressif, des modèles de gouvernance entre stations et un horizon pluriannuel. Le travail était solide. Tout le monde a agi de bonne foi.

Mais début automne, rien n’avait été lancé.

Chaque retard avait une explication rationnelle : d’abord l’infrastructure, puis l’alignement des équipes, puis les budgets, puis l’approbation du conseil. Aucune de ces étapes n’était fausse en soi. Ensemble, elles ont créé une paralysie.

Au même moment, un de leurs animateurs a commencé à publier de courts clips sur TikTok, sans roadmap ni approbation formelle. Six mois plus tard, le compte comptait des dizaines de milliers d’abonnés et une bien meilleure compréhension de ce qui fonctionne numériquement que l’organisation n’en avait gagné après des mois de planification.

Ce contraste est inconfortable, mais instructif. La planification signale le sérieux. Les tests signalent le risque. Pourtant, dans un environnement numérique, éviter les petits risques garantit presque un risque plus grand plus tard.

Concrètement, tester, ça veut dire quoi?

Le test est souvent mal compris, surtout dans les organisations façonnées par des décennies de logique broadcast. Ça ne veut pas dire agir au hasard ni abandonner les standards.

Ça veut dire réduire la portée de l’ambition pour que quelque chose puisse être livré vite et évalué honnêtement.

Dans de nombreuses organisations, des mois sont consacrés à débattre de ce qui devrait marcher dans un univers numérique. Ces discussions sont généralement guidées par l’expérience, l’intuition et des convictions bien intentionnées quant à l’audience. Le problème n’est pas que cette intuition soit fausse, mais qu’elle reste non testée.

Une alternative plus productive consiste à ne retenir qu’une seule hypothèse – par exemple, que les auditeurs souhaitent des versions plus longues et approfondies des interviews en mode à la demande – et à la confronter à la réalité. Sortir un petit nombre d’épisodes dans un format clair, puis observer ce qui se passe : est-ce que les gens commencent à écouter, est-ce qu’ils terminent, est-ce qu’ils reviennent ?

Une approche étire l’apprentissage sur des mois de discussion. L’autre le compresse en quelques semaines et apporte des preuves concrètes. Et dans un environnement numérique où les habitudes évoluent vite, le progrès vient d’un apprentissage rapide et validé plutôt que de la confiance en ce qui devrait marcher.

Ce qui pourrait vraiment être livré avant la fin du trimestre

La plupart des organisations sous-estiment à quel point elles peuvent apprendre en peu de temps si elles se concentrent.

En un seul trimestre, les équipes peuvent aller bien au-delà d’expériences isolées et générer de vraies preuves de ce qui marche. Pas des insights théoriques, mais un apprentissage validé : des signaux sur le comportement de l’audience, les formats, la distribution et la création de valeur qui peuvent vraiment informer les décisions.

En pratique, ça pourrait vouloir dire tester si une émission phare marche vraiment en podcast, explorer un format 100% numérique avant de l’exposer à l’antenne, ou distribuer un programme de manière agressive sur les plateformes pour comprendre où la découverte se produit vraiment. D’autres pourraient valider des idées de contenu ou de monétisation par des tests ciblés auprès de l’audience plutôt que par débat interne.

La différence clé n’est pas ce qui est testé, mais la vitesse à laquelle l’apprentissage se produit.

Quand l’expérimentation est structurée – avec des hypothèses claires, des boucles de feedback serrées et des points de décision explicites – des insights significatifs peuvent être produits en quelques semaines. C’est exactement pour ça qu’on organise des Sprints d’Innovation avec nos clients : en douze semaines, les équipes génèrent des idées et passent des hypothèses aux preuves, avec assez d’éléments pour décider s’il faut passer à l’échelle, pivoter ou arrêter.

Tous les tests ne réussissent pas et certaines idées sont vite abandonnées. C’est le principe. Ce qui compte, c’est qu’à la fin du trimestre, l’organisation en sait bien plus sur son audience et sur le potentiel des idées pour le numérique qu’au début de l’année, et qu’elle a quelque chose de concret à montrer.

Point important : des initiatives comme ça coûtent moins cher (financièrement et politiquement) qu’une année de plus passée à affiner des documents stratégiques. Et elles font avancer l’apprentissage à une vitesse entièrement différente.

L’effet exponentiel d’apprendre tôt

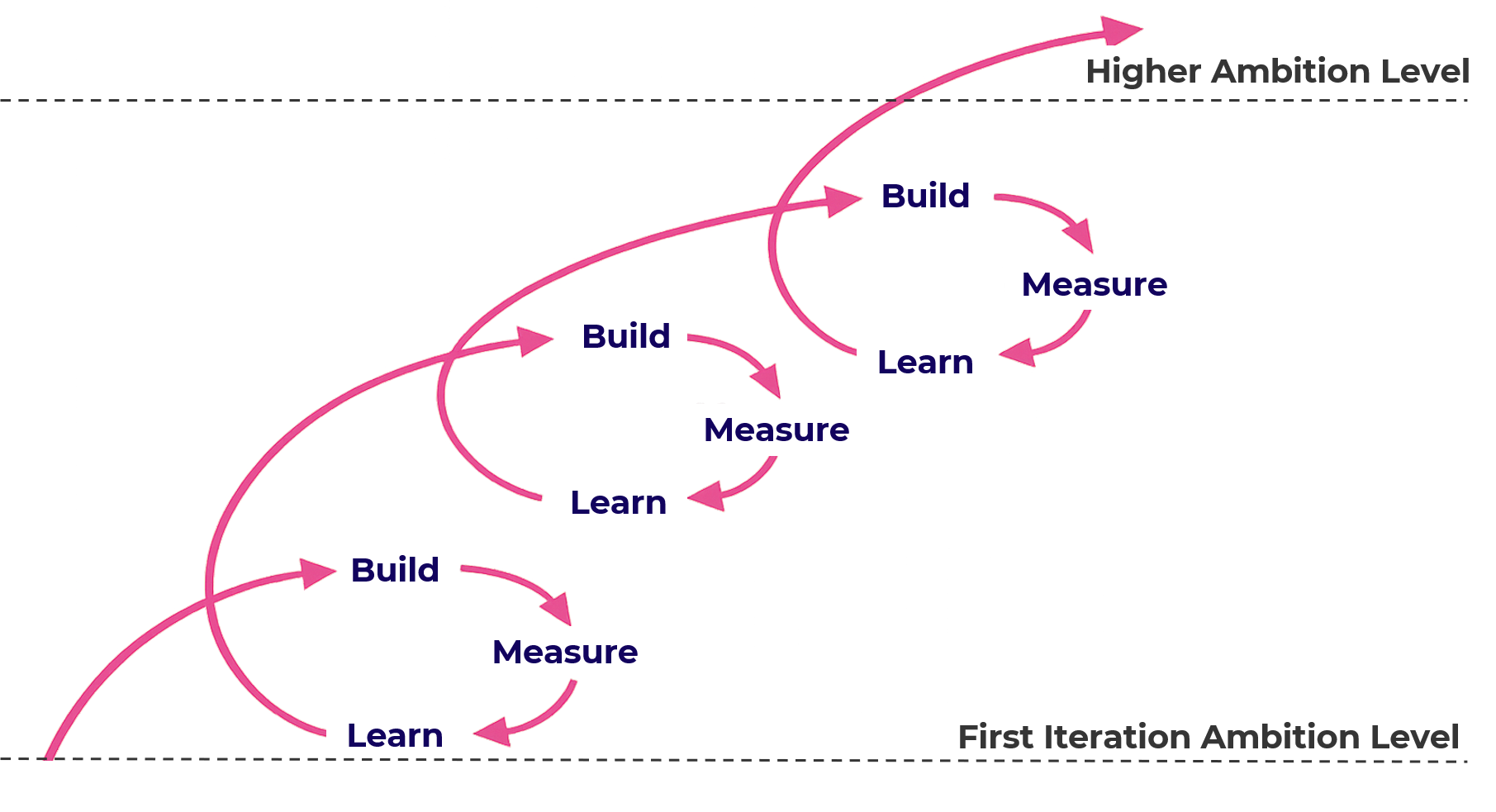

Le vrai avantage des tests précoces n’est pas que la première expérience réussisse. C’est que chaque test donne le droit de viser un peu plus haut ensuite.

Une organisation qui fait quelques tests significatifs au premier trimestre entre au deuxième avec quelque chose de rare : de vraies données sur le comportement de l’audience. Ces données orientent l’itération suivante, souvent un peu plus ambitieuse que la première. À mi-année, plusieurs hypothèses ont été validées ou écartées. À la fin de l’année, une poignée d’initiatives ne sont plus théoriques ; elles sont prouvées, affinées par des tests successifs, et prêtes à être intégrées.

Ce qui compte, ce n’est pas que les tests individuels soient spectaculaires. La plupart ne le sont pas et certains échouent dans les grandes largeurs. C’est normal. Ce qui compte, c’est que l’apprentissage se compose. Chaque cycle réduit l’incertitude, affine le focus et augmente la confiance quant à ce qui peut raisonnablement être tenté ensuite.

Le paradoxe, c’est que les organisations qui commencent avec des tests volontairement modestes atteignent souvent des ambitions plus élevées plus vite que celles qui essaient de commencer en grand. Les équipes qui retardent l’expérimentation risquent d’arriver, éventuellement, aux mêmes conclusions, mais beaucoup plus tard, et à un coût nettement plus élevé.

Là où se situe le vrai risque

Un test raté de trois semaines a rarement des conséquences au-delà d’une légère déception. Les audiences le remarquent à peine. Les marques restent intactes. Les équipes passent à autre chose.

Le risque le plus grand est bien plus silencieux : une autre année passée à discuter et à s’aligner en interne, pendant que le comportement de l’audience continue d’évoluer ailleurs. Cet écart est difficile à combler une fois qu’il devient visible dans les chiffres.

La plupart des médias historiques n’ont pas décliné parce qu’ils ont fait des paris audacieux mais ratés. Ils ont décliné parce qu’ils ont attendu trop longtemps avant d’en faire de significatifs.

Les documents stratégiques n’empêchent pas ce résultat. Les tests et l’apprentissage, oui.

Un choix simple pour 2026

Alors que l’année commence, les dirigeants radio font face à un choix moins stratégique qu’il n’y paraît.

Une voie consiste à affiner les plans de l’année dernière, à sécuriser le consensus et à repousser l’exécution jusqu’à ce que les conditions semblent idéales. L’autre consiste à s’engager sur un petit nombre de tests concrets, à accepter l’incertitude et à apprendre vite.

Les deux voies peuvent se justifier, mais une seule produit de l’élan.

À ce stade, la plupart de l’industrie de la radio a compris l’impératif de transformation numérique. Les données sont bien connues. La direction à prendre ne laisse plus de doute.

Ce qui reste ouvert, c’est de savoir si 2026 sera passée à planifier ou à tester.